Come installare Ollama su Linux in 4 passaggi

Feb 23, 2026

/

Faradilla A.

/

4 min di lettura

Ollama è una piattaforma open source che ti permette di eseguire diversi modelli linguistici di grandi dimensioni (LLM) su un server privato o sul tuo computer. La possibilità di ospitare Ollama autonomamente garantisce maggiore privacy dei dati e più controllo, rendendolo adatto alla creazione di un assistente AI personale.

Per installare Ollama su un computer personale, ti serve un sistema con almeno 16 GB di RAM, 12 GB di spazio di archiviazione e 4 core della CPU. Accedi al terminale come amministratore, aggiorna i pacchetti di sistema e installa le dipendenze necessarie. Poi installa il pacchetto Ollama e completa la procedura guidata di configurazione regolando le impostazioni in base alle tue esigenze.

In alternativa, puoi installare Ollama su una VPS Hostinger in pochi click utilizzando il template del sistema operativo. Questo metodo è più rapido e semplice rispetto all’installazione manuale ed è utile se non hai familiarità con l’utilizzo della riga di comando.

Cosa ti serve per installare Ollama

Prima di iniziare l’installazione, assicurati di avere tutto il necessario per configurare Ollama sulla tua VPS.

Hosting VPS

Ollama è un’applicazione che richiede molte risorse, quindi ti serve una VPS con almeno 16 GB di RAM, oltre 12 GB di spazio su disco e da 4 a 8 core CPU. Se vuoi eseguire modelli LLM avanzati con un numero maggiore di parametri, come DeepSeek r1, ti servono più risorse.

Se non hai ancora una VPS per installare Ollama su Linux, puoi utilizzare una VPS Hostinger. Con fino a 32 GB di RAM e 8 core CPU, è adatta per eseguire diversi LLM, inclusi quelli più esigenti in termini di risorse.

Sistema operativo

Ollama è progettato per funzionare su sistemi Linux. Per risultati ottimali, usa Ubuntu 22.04 o versioni successive, oppure l’ultima versione stabile di Debian.

Accesso e privilegi

Per installare e configurare Ollama, devi avere accesso al terminale del tuo VPS. Inoltre, ti serve accesso root oppure un account con privilegi sudo su Linux.

Installare Ollama su un VPS manualmente

Se vuoi usare Ollama sul tuo computer locale o su una VPS di un altro fornitore di hosting, puoi installarlo manualmente seguendo questi passaggi. È un processo più articolato rispetto all’utilizzo di un template preconfigurato, quindi procedi passo dopo passo.

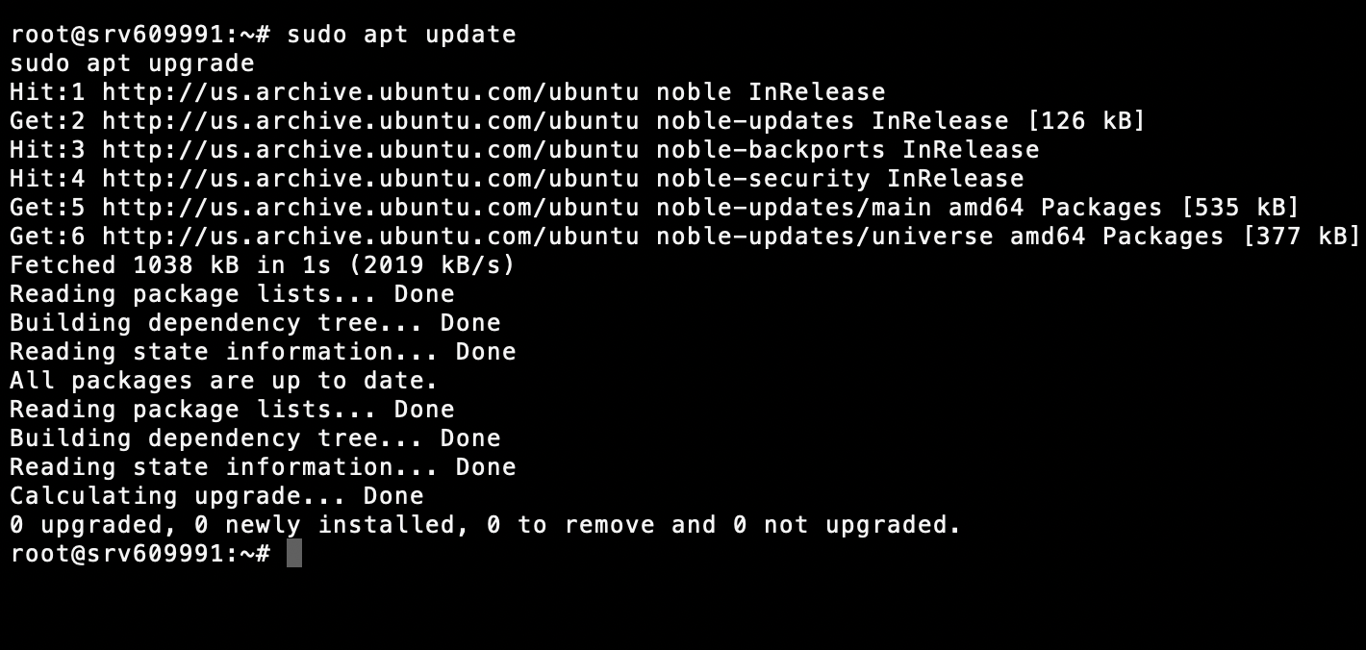

1. Aggiorna i pacchetti di sistema

Assicurati che la tua VPS sia aggiornata prima di installare nuovo software. Per aggiornare l’elenco dei pacchetti e installare gli aggiornamenti disponibili, esegui i seguenti comandi dal terminale del server:

sudo apt update sudo apt upgrade

Mantenere il sistema aggiornato ti aiuta a evitare problemi di compatibilità e garantisce un’installazione fluida dall’inizio alla fine.

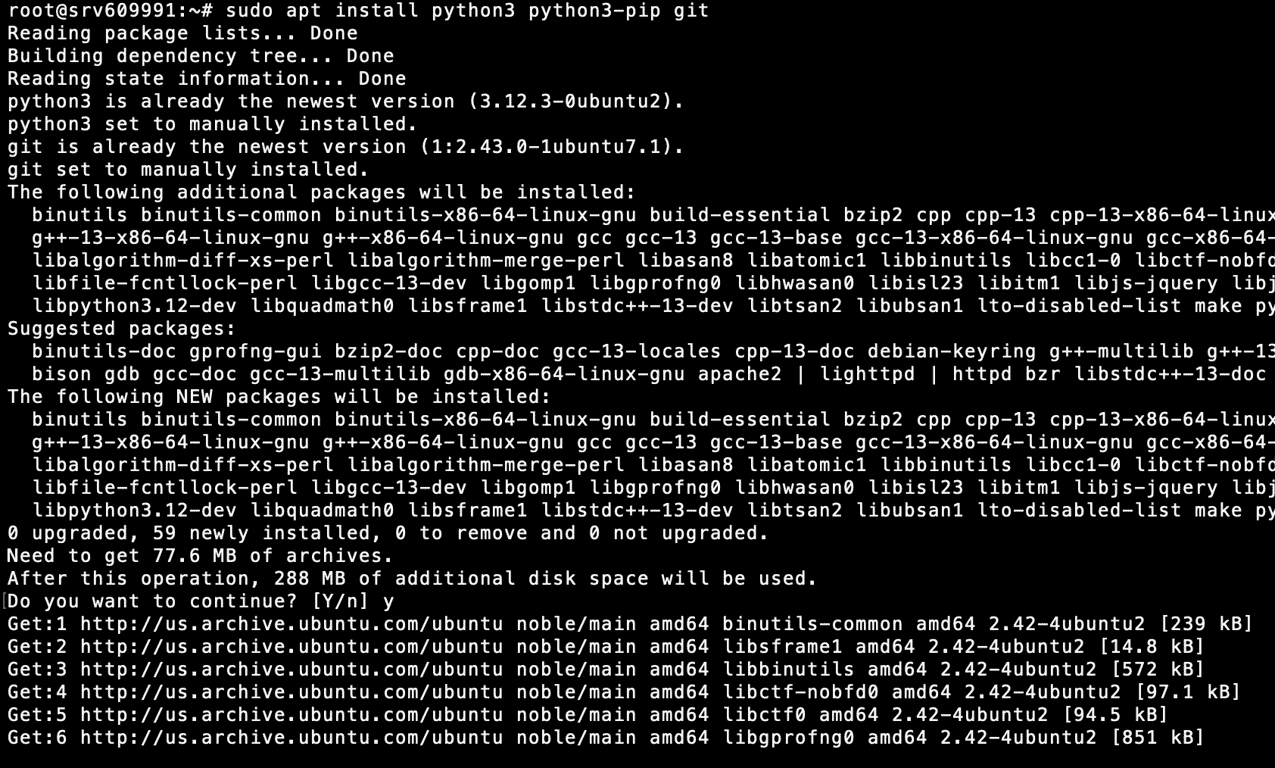

2. Installa le dipendenze necessarie

Ollama richiede alcune dipendenze per funzionare correttamente, tra cui le versioni più recenti di Python, Pip e Git. Per installarle, esegui:

sudo apt install python3 python3-pip git

Verifica che l’installazione sia andata a buon fine con:

python3 --version pip3 --version git --version

Se la tua VPS dispone di una GPU NVIDIA, ti servono anche i driver CUDA per sfruttare al meglio le prestazioni della GPU. I passaggi variano in base alla configurazione del server. Consulta la guida ufficiale NVIDIA per scaricare il CUDA Toolkit e completare l’installazione.

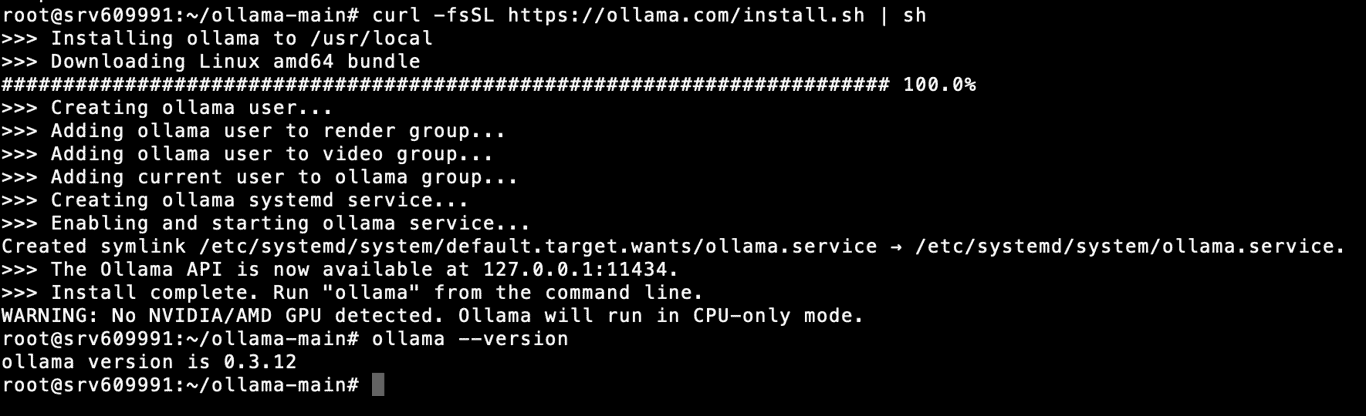

3. Scarica il pacchetto di installazione di Ollama

Scarica il pacchetto di installazione di Ollama per Linux dal sito ufficiale eseguendo:

curl -fsSL https://ollama.com/install.sh | sh

Il comando scarica e installa automaticamente Ollama sulla tua VPS. Per verificare che l’installazione sia andata a buon fine, esegui:

ollama --version

4. Avvia e configura Ollama

Ora puoi avviare Ollama con il seguente comando:

ollama serve

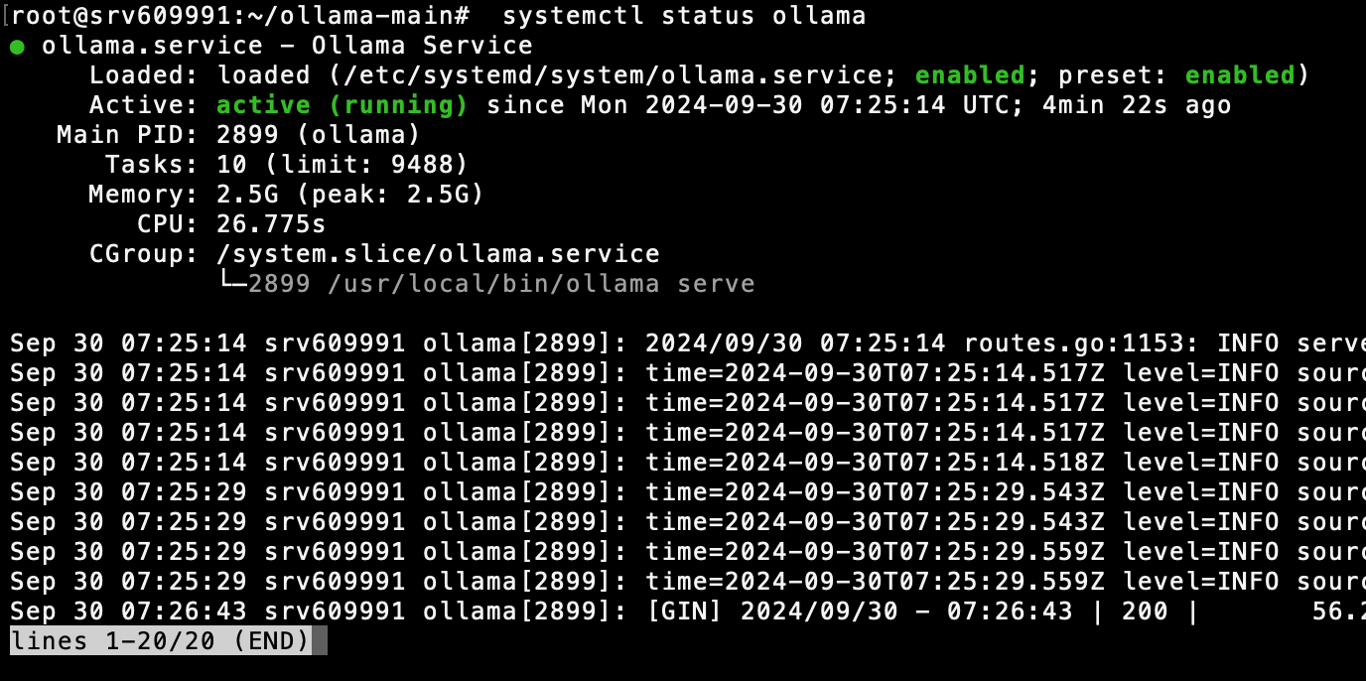

Prima di procedere, controlla lo stato del servizio Ollama eseguendo:

systemctl status ollama

Verifica dell’installazione di Ollama

Se sei cliente VPS di Hostinger, puoi usare anche Kodee AI Assistant per verificare se Ollama è attivo sul server. Accedi cliccando sul pulsante Ask Kodee in hPanel e chiedi: “Controlla se Ollama è attivo sul mio server. Il nome del server è “srv123.hstgr.cloud”.

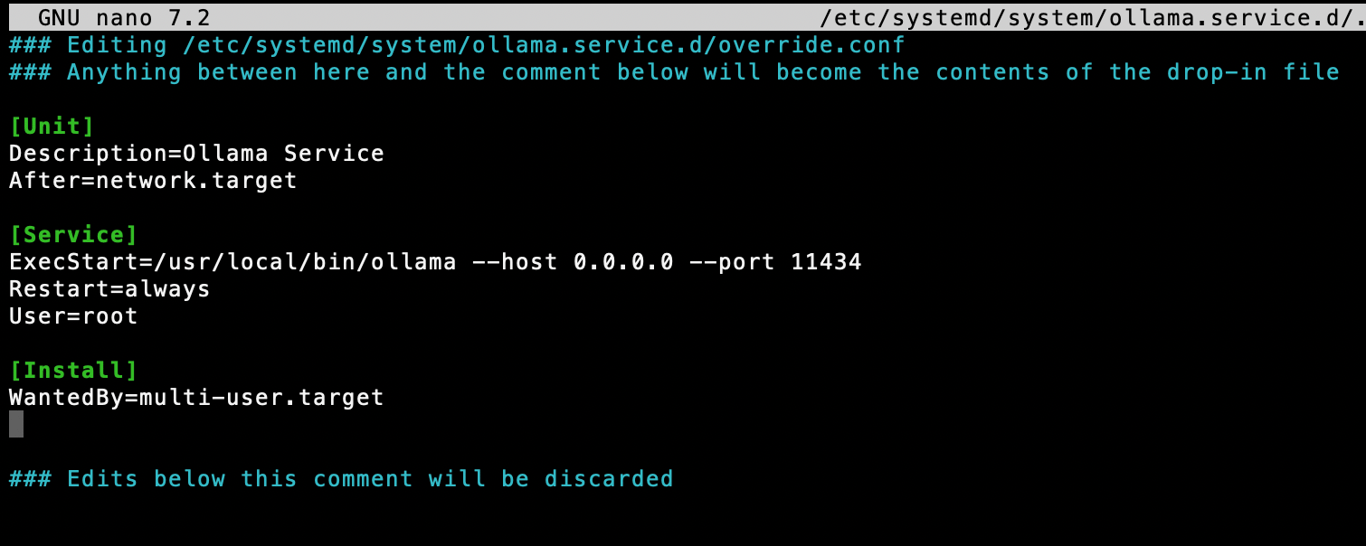

Successivamente, crea un file di servizio systemd in modo che Ollama si avvii automaticamente a ogni riavvio della VPS:

sudo nano /etc/systemd/system/ollama.service

Aggiungi il seguente contenuto al file di servizio systemd:

[Unit] Description=Ollama Service After=network.target [Service] ExecStart=/usr/local/bin/ollama --host 0.0.0.0 --port 11434 Restart=always User=root [Install] WantedBy=multi-user.target

Poi ricarica la configurazione e riavvia il servizio:

systemctl daemon-reload systemctl restart ollama

A questo punto, Ollama si avvierà automaticamente al prossimo riavvio della VPS.

Nota: anche se offre diverse opzioni di configurazione per modificare il comportamento del modello, ottimizzare le prestazioni e regolare le impostazioni del server, Ollama è progettato per funzionare immediatamente con la configurazione predefinita.

Nella maggior parte dei casi, puoi iniziare subito a scaricare i modelli necessari eseguendo: ollama pull <nome_modello>.

Posso usare un template per installare Ollama?

Sì, puoi usare un template per installare Ollama su una VPS Hostinger. Si tratta di una soluzione preconfigurata che ti permette di scaricare, installare e configurare automaticamente Ollama, incluse le dipendenze, con un solo click.

Poiché il sistema gestisce automaticamente le attività di configurazione, il processo di installazione risulta più rapido e riduce il rischio di errori.

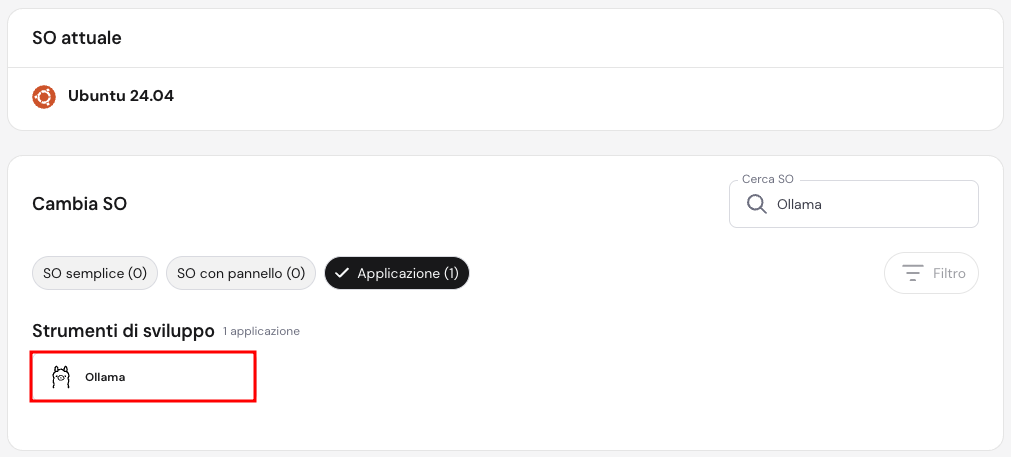

Installare Ollama con un template VPS Hostinger

Hostinger semplifica l’installazione di Ollama mettendo a disposizione un template VPS con Ubuntu 24.04 e Ollama preinstallato, a partire da €5.49/mese.

Il template include Ollama, Llama 3 e Open WebUI già installati. Devi solo selezionare il template, attendere il completamento dell’installazione automatica e accedere al server per verificare che tutto funzioni correttamente.

Per installare Ollama con un template Hostinger:

- Accedi al tuo account Hostinger e apri hPanel.

- Vai alla sezione VPS e seleziona la tua istanza.

- Fai click su SO e panello → Sistema operativo. Seleziona Ollama nella sezione Applicazioni.

- Attendi il completamento dell’installazione.

- Accedi alla VPS tramite SSH per verificare l’installazione.

A questo punto puoi iniziare a usare Ollama sulla tua VPS Hostinger per eseguire modelli LLM nelle tue applicazioni.

Poiché il template include già tutti gli strumenti e i software necessari preinstallati e configurati, non devi eseguire ulteriori passaggi prima di utilizzare i modelli.

Come usare Ollama in modo efficace

Dopo aver installato Ollama sulla tua VPS, puoi gestire e ottimizzare diversi modelli linguistici di grandi dimensioni eseguiti localmente sul server. Puoi usare Ollama per creare chatbot personalizzati o assistenti virtuali per esigenze specifiche.

Ad esempio, puoi integrare DeepSeek con Ollama per creare un agente AI dedicato ad attività tecniche come l’assistenza alla scrittura di codice. Puoi anche collegare Ollama a piattaforme di terze parti per automatizzare attività utilizzando funzionalità di AI.

Un’opzione è integrare Ollama con n8n. In questo modo puoi automatizzare operazioni che coinvolgono diverse piattaforme, strumenti e applicazioni, sfruttando le capacità di elaborazione AI per gestire e trasformare i dati.

Grazie alla flessibilità della piattaforma e alla compatibilità con diversi LLM, puoi utilizzare Ollama in numerosi scenari. Prova a sperimentare direttamente con lo strumento per capire come integrarlo nei tuoi progetti.

Tutti i contenuti dei tutorial presenti su questo sito web sono soggetti ai rigorosi standard editoriali e ai valori di Hostinger.