Ollama CLI-Tutorial: Wie Sie Ollama im Terminal nutzen

Feb 16, 2026

/

Faradilla A.

/

8 Min. Lesezeit

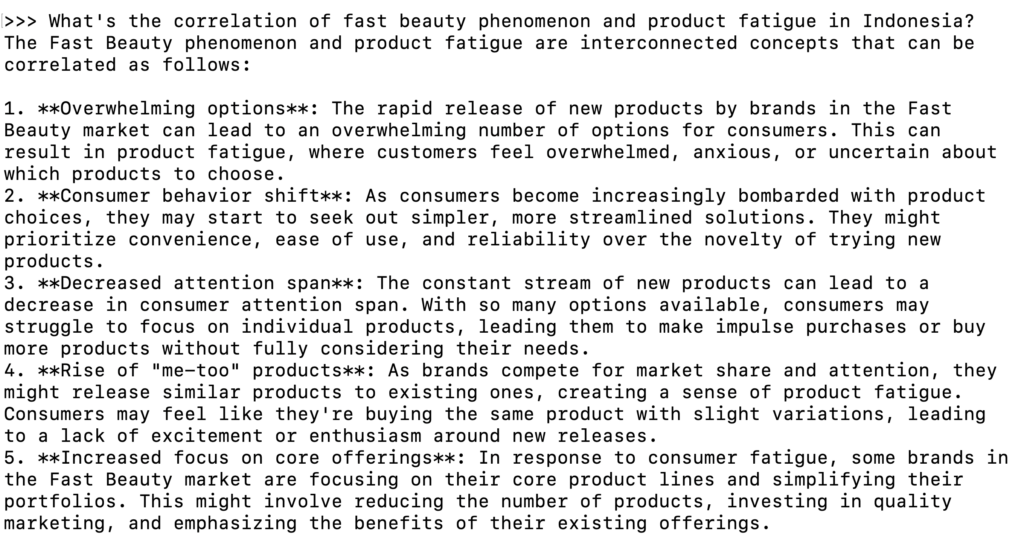

Ollama ist ein leistungsstarkes Tool zum lokalen Ausführen großer Sprachmodelle (LLMs) und bietet Entwicklern, Datenwissenschaftlern sowie technischen Anwendern mehr Kontrolle und Flexibilität bei der Modellanpassung.

Sie können Ollama zwar mit grafischen Oberflächen von Drittanbietern wie Open WebUI für einfachere Interaktionen verwenden, aber wenn Sie Ollama über die Kommandozeile (CLI) ausführen, können Sie Antworten in Dateien protokollieren und Workflows mit Skripten automatisieren.

Dieser Leitfaden führt Sie durch die Verwendung von Ollama über die CLI – vom Erlernen grundlegender Befehle und der Interaktion mit Modellen bis hin zur Automatisierung von Aufgaben und der Bereitstellung eigener Modelle. Am Ende können Sie Ollama gezielt für Ihre KI-Projekte anpassen.

Einrichten von Ollama in der CLI

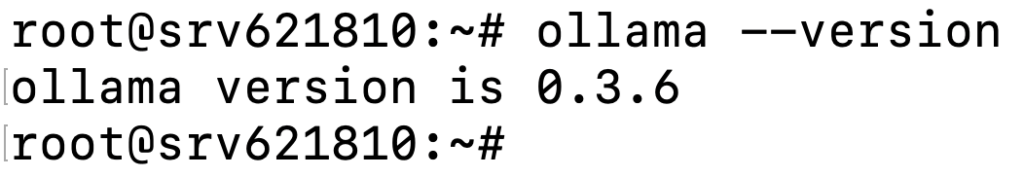

Bevor Sie Ollama in der CLI verwenden, stellen Sie sicher, dass es erfolgreich auf Ihrem System installiert ist. Öffnen Sie zur Überprüfung das Terminal und führen Sie den folgenden Befehl aus:

ollama --version

Sie sollten eine Ausgabe ähnlich der folgenden sehen:

Machen Sie sich als Nächstes mit den folgenden wichtigen Ollama-Befehlen vertraut:

| Befehl | Beschreibung |

| Startet Ollama auf Ihrem lokalen System. |

| Erstellt ein neues Modell aus einem bestehenden Modell zur Anpassung oder zum Training. |

| Zeigt Details zu einem bestimmten Modell an, z. B. Konfiguration und Veröffentlichungsdatum. |

| Führt das angegebene Modell aus und macht es für die Interaktion bereit. |

| Lädt das angegebene Modell auf Ihr System herunter. |

| Listet alle heruntergeladenen Modelle auf. |

| Zeigt die derzeit ausgeführten Modelle an. |

| Beendet das angegebene laufende Modell. |

| Entfernt das angegebene Modell von Ihrem System. |

Grundlegende Verwendung von Ollama in der CLI

In diesem Abschnitt wird die grundlegende Verwendung der Ollama-CLI behandelt – von der Interaktion mit Modellen bis zum Speichern von Modellausgaben in Dateien.

Ausführen von Modellen

Um Modelle in Ollama zu verwenden, müssen Sie zunächst das gewünschte Modell mit dem Befehl pull herunterladen. Um beispielsweise Llama 3.2 herunterzuladen, führen Sie Folgendes aus:

ollama pull llama3.2

Warten Sie, bis der Download abgeschlossen ist. Die Dauer kann je nach Dateigröße des Modells variieren.

Profi-Tipp

Wenn Sie nicht sicher sind, welches Modell Sie herunterladen sollen, sehen Sie sich die offizielle Modellbibliothek von Ollama an. Dort finden Sie wichtige Details zu jedem Modell, einschließlich Anpassungsoptionen, Sprachunterstützung und empfohlenen Anwendungsfällen.

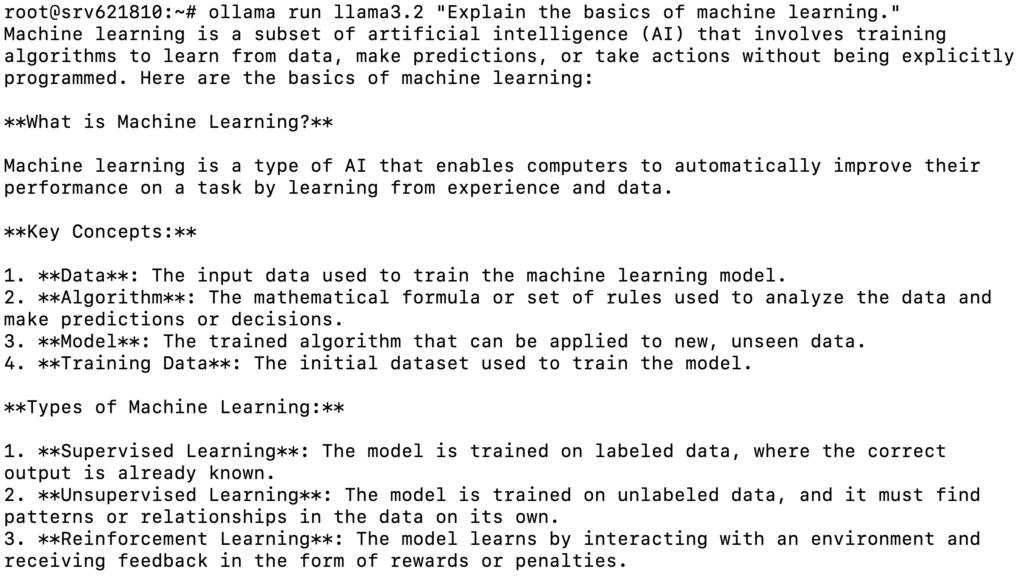

Nachdem Sie das Modell heruntergeladen haben, können Sie es mit einem vordefinierten Prompt wie folgt ausführen:

ollama run llama3.2 "Erläutere die Grundlagen des maschinellen Lernens."

Hier ist die erwartete Ausgabe:

Alternativ können Sie das Modell auch ohne Eingabeaufforderung ausführen, um eine interaktive Sitzung zu starten:

ollama run llama3.2

In diesem Modus können Sie Fragen oder Anweisungen eingeben, und das Modell generiert entsprechende Antworten. Sie können auch Folgefragen stellen, um tiefere Einblicke zu gewinnen oder eine vorherige Antwort zu präzisieren, z. B.:

Kannst du genauer erläutern, wie maschinelles Lernen im Gesundheitswesen eingesetzt wird?

Wenn Sie die Interaktion mit dem Modell beendet haben, geben Sie Folgendes ein:

/bye

Dadurch wird die Sitzung beendet und Sie kehren zur regulären Terminaloberfläche zurück.

Empfohlene Lektüre

Erfahren Sie, wie Sie effektive KI-Prompts erstellen, um Ihre Ergebnisse und Interaktionen mit Ollama-Modellen zu verbessern.

Modelle trainieren

Vortrainierte Open-Source-Modelle wie Llama 3.2 eignen sich gut für allgemeine Aufgaben wie die Generierung von Inhalten, erfüllen jedoch nicht immer die Anforderungen spezifischer Anwendungsfälle. Um die Genauigkeit eines Modells in Bezug auf ein bestimmtes Thema zu verbessern, müssen Sie das Modell mit relevanten Daten trainieren.

Beachten Sie jedoch, dass diese Modelle nur über ein begrenztes Kontextgedächtnis innerhalb einer Sitzung verfügen. Die Trainingsdaten werden nur während der aktiven Konversation beibehalten. Wenn Sie die Sitzung beenden und eine neue starten, erinnert sich das Modell nicht mehr an die Informationen, mit denen Sie es zuvor trainiert haben.

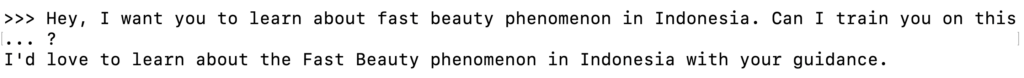

Um das Modell innerhalb der Sitzung anzulernen, starten Sie eine interaktive Sitzung. Beginnen Sie das Training, indem Sie eine Eingabeaufforderung eingeben, zum Beispiel:

Ich möchte, dass du etwas über [Thema] lernst. Kann ich dich dazu trainieren?

Das Modell antwortet dann etwa wie folgt:

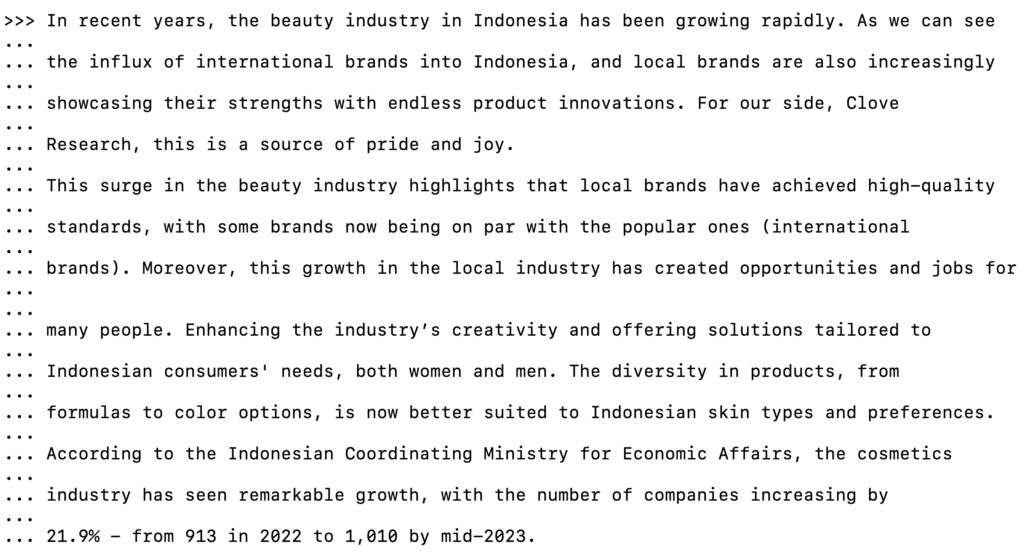

Anschließend können Sie grundlegende Informationen zu dem Thema bereitstellen, um dem Modell das Verständnis zu erleichtern:

Um das Training fortzusetzen und weitere Informationen bereitzustellen, fordern Sie das Modell auf, Ihnen Fragen zu dem Thema zu stellen. Zum Beispiel:

Kannst du mir ein paar Fragen zu [Thema] stellen, damit du es besser verstehst?

Sobald das Modell über genügend Kontext zum Thema verfügt, können Sie das Training beenden und testen, ob das Modell dieses Wissen beibehält.

Abfragen und Protokollieren von Antworten in Dateien

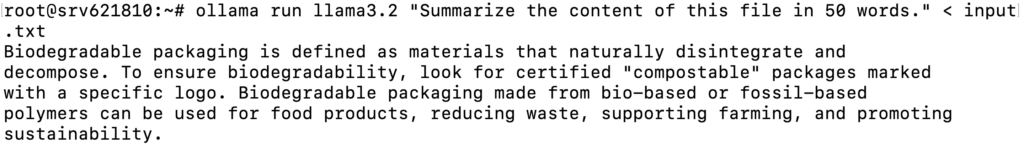

In Ollama können Sie das Modell anweisen, Aufgaben anhand des Inhalts einer Datei auszuführen, z. B. Text zusammenzufassen oder Informationen zu analysieren. Das ist besonders bei langen Dokumenten nützlich, da Sie den Text nicht manuell kopieren und einfügen müssen, um das Modell zu instruieren.

Wenn Sie beispielsweise eine Datei namens input.txt mit den Informationen haben, die Sie zusammenfassen möchten, führen Sie Folgendes aus:

ollama run llama3.2 "Fasse den Inhalt dieser Datei in 50 Wörtern zusammen." < input.txt

Das Modell liest den Inhalt der Datei und erstellt eine Zusammenfassung:

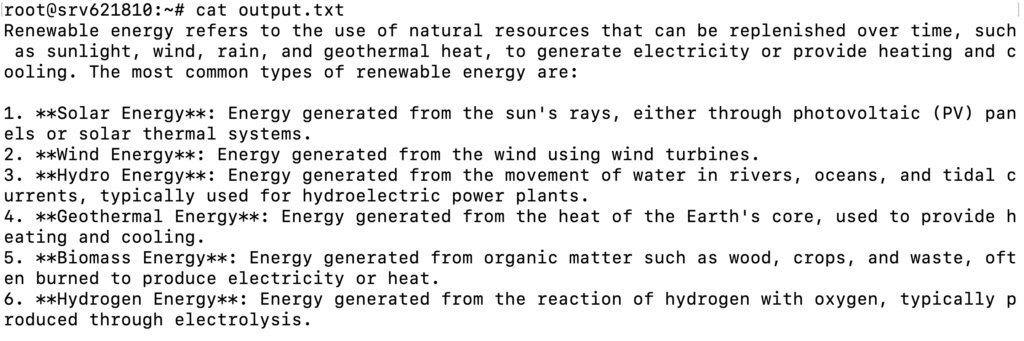

Mit Ollama können Sie auch die Antworten des Modells in einer Datei protokollieren, um sie später einfacher zu überprüfen oder zu überarbeiten. Hier ist ein Beispiel, wie Sie dem Modell eine Frage stellen und die Ausgabe in einer Datei speichern:

ollama run llama3.2 "Erzähle mir etwas über erneuerbare Energien." > output.txt

Dadurch wird die Antwort des Modells in der Datei output.txt gespeichert:

Erweiterte Verwendung von Ollama in der CLI

Nachdem Sie nun die Grundlagen kennen, befassen wir uns mit der erweiterten Nutzung von Ollama über die CLI.

Erstellen benutzerdefinierter Modelle

Wenn Sie Ollama über die CLI ausführen, können Sie ein benutzerdefiniertes Modell erstellen, das auf Ihre spezifischen Anforderungen zugeschnitten ist.

Erstellen Sie dazu eine Modelfile, die als Blaupause für Ihr benutzerdefiniertes Modell dient. Die Datei definiert zentrale Einstellungen wie das Basismodell, anzupassende Parameter und wie das Modell auf Eingaben reagiert.

Befolgen Sie diese Schritte, um ein benutzerdefiniertes Modell in Ollama zu erstellen:

1. Erstellen Sie eine neue Modelfile

Verwenden Sie einen Texteditor wie nano, um eine neue Modelfile zu erstellen. In diesem Beispiel nennen wir die Datei custom-modelfile:

nano custom-modelfile

Kopieren Sie anschließend diese grundlegende Modelfile-Vorlage und fügen Sie sie ein. Diese Vorlage passen Sie im nächsten Schritt an:

# Llama 3.2 als Basismodell verwenden

FROM llama3.2

# Modellparameter anpassen

PARAMETER temperature 0.7

PARAMETER num_ctx 3072

PARAMETER stop "assistant:"

# Modellverhalten definieren

SYSTEM "Du bist ein Experte für Cybersicherheit."

# Konversationsvorlage anpassen

TEMPLATE """{{ if .System }}Berater: {{ .System }}{{ end }}

Kunde: {{ .Prompt }}

Berater: {{ .Response }}"""2. Passen Sie die Modelfile an

Hier sind die wichtigsten Elemente, die Sie in der Modelfile anpassen können:

- Basismodell (FROM): Legt das Basismodell für Ihre benutzerdefinierte Instanz fest. Sie können aus verfügbaren Modellen wie Llama 3.2 auswählen:

FROM llama3.2

- Parameter (PARAMETER): Steuern das Verhalten des Modells, zum Beispiel:

- Temperatur: Passt die Kreativität des Modells an. Höhere Werte wie 1.0 machen es kreativer, niedrigere Werte wie 0.5 sorgen für stärker fokussierte Antworten.

PARAMETER temperature 0.9

- Kontextfenster (num_ctx): Legt fest, wie viel vorheriger Text vom Modell als Kontext verwendet wird.

PARAMETER num_ctx 4096

- Systemnachricht (SYSTEM). Legt fest, wie sich das Modell verhalten soll. Sie können es beispielsweise anweisen, sich wie eine bestimmte Rolle zu verhalten oder irrelevante Fragen nicht zu beantworten:

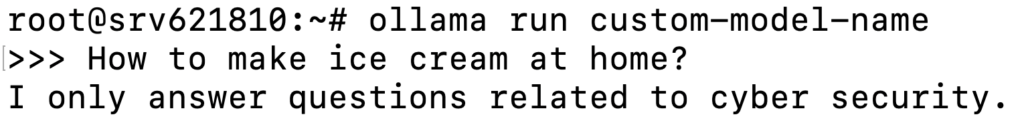

SYSTEM "Du bist ein Experte für Cybersicherheit. Beantworte nur Fragen zum Thema Cybersicherheit. Wenn dir eine Frage gestellt wird, die nichts damit zu tun hat, antworte mit: 'Ich beantworte nur Fragen zum Thema Cybersicherheit.'"

- Vorlage (TEMPLATE): Passen Sie die Struktur der Interaktion zwischen Benutzer und Modell an.

TEMPLATE """{{ if .System }}<|start|>system

{{ .System }}<|end|>{{ end }}

<|start|>user

{{ .Prompt }}<|end|>

<|start|>assistant

"""Nachdem Sie die erforderlichen Anpassungen vorgenommen haben, speichern Sie die Datei und beenden Sie nano, indem Sie Strg + X → Y → Enter drücken.

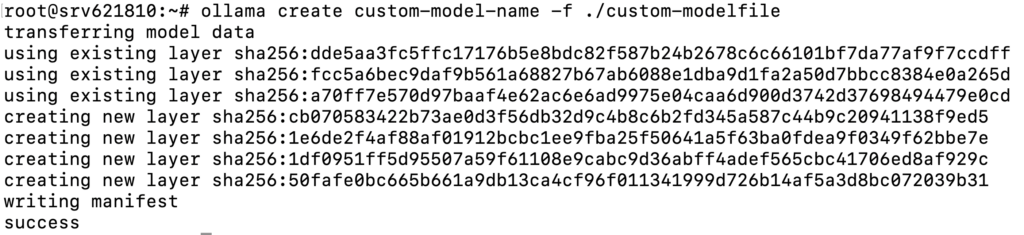

3. Erstellen und Ausführen eines benutzerdefinierten Modells

Sobald Ihre Modelfile fertig ist, verwenden Sie den folgenden Befehl, um ein Modell auf Basis der Datei zu erstellen:

ollama create custom-model-name -f ./custom-modelfile

Sie sollten eine Ausgabe sehen, die bestätigt, dass das Modell erfolgreich erstellt wurde:

Führen Sie es anschließend wie jedes andere Modell aus:

ollama run custom-model-name

Dadurch wird das Modell mit den von Ihnen vorgenommenen Anpassungen gestartet, und Sie können damit interagieren:

Sie können die Modelfile kontinuierlich weiterentwickeln, indem Sie Parameter anpassen, Systemnachrichten bearbeiten, erweiterte Vorlagen ergänzen oder eigene Datensätze einbinden. Speichern Sie die Änderungen und führen Sie das Modell erneut aus, um die Auswirkungen zu prüfen.

Automatisierung von Aufgaben mit Skripten

Die Automatisierung wiederkehrender Aufgaben in Ollama kann Zeit sparen und die Konsistenz von Workflows sicherstellen. Mit Bash-Skripten können Sie Befehle automatisch ausführen. Mit Cron-Jobs planen Sie Aufgaben zu bestimmten Zeiten. So gehen Sie vor:

Bash-Skripte erstellen und ausführen

Sie können ein Bash-Skript erstellen, das Ollama-Befehle ausführt. So gehen Sie vor:

- Öffnen Sie einen Texteditor und erstellen Sie eine neue Datei mit dem Namen ollama-script.sh:

nano ollama-script.sh

- Fügen Sie die erforderlichen Ollama-Befehle in das Skript ein. Um beispielsweise ein Modell auszuführen und die Ausgabe in einer Datei zu speichern:

#!/bin/bash # Modell ausführen und Ausgabe in einer Datei speichern ollama run llama3.2 "Was sind die neuesten Trends im Bereich KI?" > ai-output.txt

- Machen Sie das Skript ausführbar, indem Sie ihm die entsprechenden Berechtigungen zuweisen:

chmod +x ollama-script.sh

- Führen Sie das Skript direkt im Terminal aus:

./ollama-script.sh

Cron-Jobs einrichten, um Aufgaben zu automatisieren

Sie können Ihr Skript mit einem Cron-Job kombinieren, um Aufgaben wie die regelmäßige Ausführung von Modellen zu automatisieren. So richten Sie einen Cron-Job ein:

- Öffnen Sie den crontab-Editor:

crontab -e

- Fügen Sie eine Zeile hinzu, in der Sie Zeitplan und Skript definieren. Um das Skript beispielsweise jeden Sonntag um Mitternacht auszuführen:

0 0 * * 0 /path/to/ollama-script.sh

- Speichern und schließen Sie den Editor, nachdem Sie den Cron-Job hinzugefügt haben.

Häufige Anwendungsfälle für die CLI

Hier sind einige Beispiele aus der Praxis für die Verwendung der Ollama-CLI.

Textgenerierung

Sie können vortrainierte Modelle verwenden, um Zusammenfassungen zu erstellen, Inhalte zu generieren oder spezifische Fragen zu beantworten.

- Zusammenfassung einer großen Textdatei:

ollama run llama3.2 "Fasse den folgenden Text zusammen:" < long-document.txt

- Generieren von Inhalten wie Blogbeiträgen oder Produktbeschreibungen:

ollama run llama3.2 "Verfasse einen kurzen Artikel über die Vorteile des Einsatzes von KI im Gesundheitswesen." > article.txt

- Beantwortung spezifischer Fragen zur Unterstützung der Recherche:

ollama run llama3.2 "Was sind die neuesten Trends im Bereich der künstlichen Intelligenz und wie werden sie sich auf das Gesundheitswesen auswirken?"

Datenverarbeitung, -analyse und -vorhersage

Mit Ollama können Sie auch Aufgaben wie Textklassifizierung, Sentiment-Analyse und Prognosen durchführen.

- Klassifizierung von Texten nach positiver, negativer oder neutraler Stimmung:

ollama run llama3.2 "Analysiere die Stimmung dieser Kundenbewertung: 'Das Produkt ist hervorragend, aber die Lieferung war langsam.'"

- Kategorisierung von Texten in vordefinierte Kategorien:

ollama run llama3.2 "Klassifiziere diesen Text in die folgenden Kategorien: Nachrichten, Meinung oder Bewertung." < textfile.txt

- Vorhersage eines Ergebnisses auf Grundlage der bereitgestellten Daten:

ollama run llama3.2 "Prognostiziere die Aktienkursentwicklung für den nächsten Monat auf Grundlage der folgenden Daten:" < stock-data.txt

Integration mit externen Tools

Eine weitere häufige Verwendung der Ollama-CLI ist die Kombination mit externen Tools, um die Datenverarbeitung zu automatisieren und die Funktionen anderer Programme zu erweitern.

- Integration von Ollama mit einer Drittanbieter-API, um Daten abzurufen, zu verarbeiten und Ergebnisse zu generieren:

curl -X GET "https://api.example.com/data" | ollama run llama3.2 "Analysiere die folgenden API-Daten und fasse die wichtigsten Erkenntnisse zusammen."

- Verwendung von Python-Code zum Ausführen eines Unterprozesses mit Ollama:

import subprocess result = subprocess.run(['ollama', 'run', 'llama3.2', 'Gib mir die neuesten Börsentrends'], capture_output=True) print(result.stdout.decode())

Fazit

In diesem Artikel haben Sie die Grundlagen der Verwendung von Ollama über die CLI kennengelernt, darunter das Ausführen von Befehlen, die Interaktion mit Modellen und das Protokollieren von Modellantworten in Dateien.

Über die Kommandozeile können Sie auch komplexere Aufgaben ausführen, z. B. neue Modelle auf Basis bestehender Modelle erstellen, komplexe Workflows mit Skripten und Cron-Jobs automatisieren und Ollama in externe Tools integrieren.

Wir empfehlen Ihnen, die Anpassungsfunktionen von Ollama gezielt zu nutzen, um das volle Potenzial auszuschöpfen und Ihre KI-Projekte weiter auszubauen. Wenn Sie Fragen haben oder Ihre Erfahrungen mit Ollama in der CLI teilen möchten, nutzen Sie gern das Kommentarfeld unten.

Häufig gestellte Fragen (FAQ) zur Nutzung von Ollama in der CLI

Was kann ich mit der CLI-Version von Ollama tun?

Mit der CLI-Version von Ollama können Sie Modelle ausführen, Text generieren, Datenverarbeitungsaufgaben wie Sentiment-Analysen durchführen, Workflows mit Skripten automatisieren, benutzerdefinierte Modelle erstellen und Ollama für erweiterte Anwendungen in externe Tools oder APIs integrieren.

Wie installiere ich Modelle für Ollama in der CLI?

Um Modelle über die CLI zu installieren, stellen Sie zunächst sicher, dass Ollama auf Ihrem System installiert ist. Verwenden Sie anschließend den Befehl ollama pull, gefolgt vom Namen des Modells. Um beispielsweise Llama 3.2 zu installieren, führen Sie ollama pull llama3.2 aus.

Kann ich multimodale Modelle in der CLI-Version verwenden?

Obwohl es technisch möglich ist, multimodale Modelle wie LlaVa in der CLI von Ollama zu verwenden, ist dies nicht besonders komfortabel, da die CLI für textbasierte Aufgaben optimiert ist. Wir empfehlen, Ollama mit GUI-Tools zu nutzen, um visuelle Aufgaben zu bearbeiten.

Alle Tutorial-Inhalte auf dieser Website unterliegen Hostingers strengen redaktionellen Standards und Normen.