Tutoriel Kubernetes : apprendre les bases d’une gestion efficace des conteneurs

Mar 03, 2026

/

Chaimaa C.

/

17 minutes de lecture

Kubernetes, souvent abrégé en K8s, est un choix de premier ordre pour l’orchestration de conteneurs en raison de son évolutivité, de sa flexibilité et de sa robustesse. Que vous soyez développeur ou administrateur système, la maîtrise de Kubernetes peut simplifier le déploiement, la mise à l’échelle et la gestion des applications conteneurisées.

Dans cet article, vous apprendrez les concepts de base de Kubernetes, découvrirez ses principales fonctionnalités et examinerez ses avantages et ses inconvénients. Nous vous guiderons dans la configuration d’un environnement Kubernetes, le déploiement de votre première application et le dépannage des problèmes courants.

À la fin de ce tutoriel, vous serez en mesure d’exploiter pleinement Kubernetes pour une gestion efficace des conteneurs.

Qu'est-ce que Kubernetes ?

Kubernetes est une puissante plateforme open source pour l’orchestration de conteneurs. Elle fournit un cadre efficace pour déployer, dimensionner et gérer des applications, en garantissant leur fonctionnement transparent sur un cluster de machines.

L’architecture de Kubernetes offre une interface cohérente pour les développeurs et les administrateurs. Elle permet aux équipes de se concentrer sur le développement d’applications sans être distraites par la complexité de l’infrastructure sous-jacente.

Cet outil informatique garantit le fonctionnement fiable des applications conteneurisées, en gérant efficacement le déploiement et la mise à l’échelle tout en abstraisant les configurations matérielles et réseau.

Comment fonctionne Kubernetes ?

Kubernetes fonctionne grâce à un plan de contrôle et à des composants centraux, chacun ayant un rôle spécialisé dans la gestion des applications conteneurisées à travers les clusters.

Nœuds

Les nœuds sont les machines individuelles qui constituent l’épine dorsale d’un cluster Kubernetes. Il peut s’agir de nœuds maîtres ou de nœuds de travail, qui sont essentiels pour l’exécution de plusieurs conteneurs. Les nœuds peuvent fonctionner à la fois sur des serveurs physiques et des serveurs privés virtuels.

Pods

Les pods sont les plus petites unités déployables sur cette plateforme. Ils constituent les éléments de base des applications Kubernetes. Un pod peut contenir un ou plusieurs conteneurs. Kubernetes planifie ces conteneurs ensemble sur le même nœud afin d’optimiser la communication et l’équilibrage de charge.

Services

Les services rendent les applications accessibles en ligne et gèrent l’équilibrage de charge. Ils fournissent un moyen cohérent d’accéder aux services conteneurisés et masquent la complexité de la connectivité réseau.

Serveur API

Le serveur API est le front-end du plan de contrôle Kubernetes. Il traite les requêtes internes et externes afin de gérer divers aspects du cluster.

Ensembles de réplication

Ils maintiennent un nombre spécifié de pods identiques afin de garantir une haute disponibilité et une grande fiabilité. Si un pod tombe en panne, le jeu de réplication le remplace automatiquement.

Contrôleurs d’entrée

Les contrôleurs d’entrée agissent comme des gardiens du trafic entrant vers votre cluster Kubernetes, gérant l’accès aux services au sein du cluster et facilitant l’accès externe.

Ces composants permettent collectivement à Kubernetes de gérer efficacement la complexité des charges de travail conteneurisées au sein de systèmes distribués.

Principales fonctionnalités de Kubernetes

Kubernetes offre un ensemble robuste de fonctionnalités conçues pour répondre aux besoins des applications conteneurisées modernes :

Évolutivité

Kubernetes ajuste dynamiquement le nombre de conteneurs en cours d’exécution en fonction de la demande, garantissant ainsi une utilisation optimale des ressources. Cette adaptabilité permet de réduire les coûts tout en maintenant une expérience utilisateur fluide.

Équilibrage de charge

L’équilibrage de charge fait partie intégrante de Kubernetes. Il répartit efficacement le trafic entrant entre plusieurs pods, garantissant une haute disponibilité et des performances optimales, tout en empêchant la surcharge d’un seul pod.

Auto-réparation

Les capacités d’auto-réparation de Kubernetes minimisent les temps d’arrêt. Si un conteneur ou un pod tombe en panne, il est automatiquement remplacé, ce qui permet à votre application de continuer à fonctionner sans heurts et garantit une prestation de services cohérente.

Découverte de services et métadonnées

La découverte de services est rationalisée dans Kubernetes, ce qui facilite la communication entre les différents composants de l’application. Les métadonnées améliorent ces interactions, simplifiant ainsi les complexités associées aux systèmes distribués.

Mises à jour et restaurations progressives

Kubernetes prend en charge les mises à jour progressives afin de maintenir la disponibilité continue du service. Si une mise à jour pose des problèmes, il est possible de revenir rapidement et facilement à une version stable précédente.

Gestion des ressources

Kubernetes permet une gestion précise des ressources en vous laissant définir des limites et des demandes de ressources pour les pods, garantissant ainsi une utilisation efficace du CPU et de la mémoire.

ConfigMaps, secrets et variables d’environnement

Kubernetes utilise ConfigMaps et Secrets pour une gestion sécurisée des configurations. Ces outils permettent de stocker et de gérer en toute sécurité des informations sensibles telles que les clés API et les mots de passe, en les protégeant contre tout accès non autorisé.

Avantages et inconvénients de Kubernetes

Il est essentiel d’évaluer les forces et les faiblesses de Kubernetes afin de déterminer s’il s’agit de la plateforme adaptée à vos besoins en matière de gestion de conteneurs.

Avantages de Kubernetes

Kubernetes offre de nombreux avantages, ce qui en fait une option privilégiée pour la gestion des applications conteneurisées. Voici ce qui le distingue :

Évolutivité

- Évolutivité sans effort. Kubernetes peut automatiquement s’adapter en déployant des conteneurs supplémentaires à mesure que la demande augmente, sans intervention manuelle.

- Aucun temps d’arrêt. Lors des déploiements, Kubernetes utilise un équilibreur de charge pour répartir le trafic entre les conteneurs existants et les nouveaux, garantissant ainsi un service continu.

Haute disponibilité

- Basculement automatique. En cas de défaillance d’un conteneur ou d’un nœud, Kubernetes redirige automatiquement le trafic vers des conteneurs ou des nœuds fonctionnels, minimisant ainsi les temps d’arrêt.

- Équilibrage de charge. L’équilibrage de charge intégré répartit le trafic entrant entre plusieurs pods, améliorant ainsi les performances et garantissant la disponibilité du service.

Flexibilité et extensibilité

- Ressources et opérateurs personnalisés. Kubernetes vous permet de créer des ressources et des opérateurs personnalisés, étendant ainsi ses fonctionnalités de base pour mieux répondre aux besoins spécifiques de votre entreprise.

- Outils de référence. La nature open source et le solide soutien de la communauté favorisent un riche écosystème d’extensions et d’outils. Cela permet d’améliorer en permanence votre environnement Kubernetes grâce à divers modules complémentaires, allant des solutions de surveillance aux outils d’accès externes.

Inconvénients de Kubernetes

Bien que Kubernetes soit une plateforme robuste, elle présente certains inconvénients que vous devez prendre en compte :

Complexité

La courbe d’apprentissage abrupte de Kubernetes peut constituer un obstacle, en particulier pour les nouveaux utilisateurs. Une expertise dans la gestion des clusters Kubernetes est essentielle pour exploiter pleinement ses capacités.

Intensité en ressources

Kubernetes nécessite d’importantes ressources serveur, notamment en termes de CPU, de mémoire et de stockage. Pour les petites applications ou les organisations disposant de ressources limitées, cela peut entraîner plus de frais généraux que d’avantages.

Absence de solutions de stockage natives

Kubernetes ne comprend pas de solutions de stockage intégrées, ce qui pose des défis pour les applications nécessitant un stockage de données persistant ou sensible. Par conséquent, vous devez intégrer des solutions de stockage externes, telles que le stockage en réseau (NAS), les réseaux de stockage (SAN) ou les services cloud.

Comment configurer Kubernetes

La configuration de Kubernetes est essentielle pour gérer efficacement les conteneurs. Votre environnement d’hébergement joue un rôle central. Les plans VPS de Hostinger offrent les ressources et la stabilité nécessaires à un cluster Kubernetes.

Veuillez noter que les étapes suivantes s’appliquent à tous les nœuds que vous utiliserez pour déployer vos applications.

1. Choisir une méthode de déploiement

- Environnement local. Idéal pour l’apprentissage, les tests et le développement, le déploiement de Kubernetes sur une machine locale peut être effectué à l’aide d’outils tels que Minikube et Kind (Kubernetes dans Docker). Cette méthode est rapide et pratique pour les particuliers et les petites équipes, mais elle peut nécessiter plus de ressources que les autres méthodes.

- Kubernetes auto-hébergé. Cette méthode consiste à configurer et à gérer votre propre cluster Kubernetes à partir de zéro. Elle offre plus de contrôle et de flexibilité, mais nécessite beaucoup de temps et d’expertise, ce qui la rend adaptée aux grandes organisations ayant des besoins complexes en matière d’infrastructure ou des exigences de conformité spécifiques.

- Services Kubernetes gérés. Pour la plupart des charges de travail de production et des projets à grande échelle, envisagez d’opter pour un service géré tel qu’Amazon EKS, Google Kubernetes Engine (GKE) ou Azure Kubernetes Service (AKS). Ces services sont réputés pour leur facilité d’utilisation et leur robustesse, offrant évolutivité et fiabilité sans frais administratifs supplémentaires.

Choisir le bon environnement

- Si vous débutez et recherchez une expérience sans tracas pour l’apprentissage et le développement, un environnement local est recommandé.

- Si vous pouvez y consacrer le temps et l’expertise nécessaires, Kubernetes auto-hébergé est approprié pour un contrôle total et une configuration sur mesure.

- Les services gérés sont les mieux adaptés à la plupart des scénarios de production, offrant évolutivité et fiabilité avec un minimum d’efforts administratifs.

2. Configurer l’environnement

Nous vous guiderons dans la configuration d’un environnement Kubernetes sur Hostinger à l’aide d’un système d’exploitation Ubuntu 24.04 64 bits. Suivez ces étapes :

- Connectez-vous à votre VPS via un client SSH tel que PuTTY. Une fois connecté, assurez-vous que votre VPS est à jour à l’aide de cette commande :

sudo apt-get update && sudo apt-get upgrade

- Kubernetes s’appuie sur un runtime de conteneur, tel que Docker. Installez Docker sur votre VPS en exécutant la commande suivante :

sudo apt install docker.io

- Activez et démarrez Docker en tant que service système à l’aide des commandes Linux suivantes :

sudo systemctl enable docker

sudo systemctl start docker

- Désactivez les swaps sur tous les nœuds pour améliorer les performances de Kubernetes :

sudo swapoff -a

sudo sed -i '/ swap / s/^\(.*\)$/#\1/g' /etc/fstab

- Utilisez tee pour charger les modules du noyau requis pour Kubernetes :

sudo tee /etc/modules-load.d/containerd.conf <<EOF

overlay

br_netfilter

EOF

sudo modprobe overlay

sudo modprobe br_netfilter

- Ajoutez les paramètres du noyau nécessaires pour la mise en réseau Kubernetes :

sudo tee /etc/sysctl.d/kubernetes.conf <<EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

EOF

- Appliquez toutes les modifications en rechargeant les paramètres système :

sudo sysctl --system

3. Installer le runtime containerd

Après avoir configuré l’environnement, procédez à l’installation de containerd, un runtime de conteneurs qui gère le cycle de vie des conteneurs et leurs dépendances sur vos nœuds. Voici comment procéder :

- Exécutez la commande suivante pour installer les paquets nécessaires à containerd :

sudo apt-get install apt-transport-https ca-certificates curl software-properties-common

- Utilisez curl pour ajouter le référentiel Docker à votre système :

curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo gpg --dearmour -o /etc/apt/trusted.gpg.d/docker.gpg

sudo add-apt-repository "deb [arch=amd64] https://download.docker.com/linux/ubuntu $(lsb_release -cs) stable"

- Mettez à jour la liste des paquets de votre système et installez containerd :

sudo apt update

sudo apt install containerd.io

- Configurez containerd pour utiliser systemd comme gestionnaire de cgroup à l’aide des commandes suivantes :

containerd config default | sudo tee /etc/containerd/config.toml >/dev/null

sudo sed -i 's/SystemdCgroup = false/SystemdCgroup = true/'/etc/containerd/config.toml

- Appliquez les modifications en redémarrant et en activant le service containerd :

sudo systemctl restart containerd sudo systemctl enable containerd

4. Installer Kubernetes

Une fois l’environnement préparé, vous pouvez commencer à installer les composants essentiels de Kubernetes sur votre hôte. Suivez ces étapes détaillées :

- Récupérez la clé de signature publique pour les référentiels de paquets Kubernetes :

curl -fsSL https://pkgs.k8s.io/core:/stable:/v1.30/deb/Release.key | sudo gpg --dearmor -o /etc/apt/keyrings/kubernetes-apt-keyring.gpg

- Exécutez la commande suivante pour ajouter le référentiel apt Kubernetes approprié :

echo 'deb [signed-by=/etc/apt/keyrings/kubernetes-apt-keyring.gpg] https://pkgs.k8s.io/core:/stable:/v1.30/deb/ /' | sudo tee /etc/apt/sources.list.d/kubernetes.list

- Mettez à jour vos listes de paquets et installez les composants Kubernetes :

sudo apt-get update

sudo apt-get install kubelet kubeadm kubectl

- Empêchez les mises à jour automatiques de ces composants en fixant leurs versions :

sudo apt-mark hold kubelet kubeadm kubectl

- Vous pouvez également activer le service kubelet pour qu’il démarre immédiatement à l’aide de cette commande :

sudo systemctl enable –now kubelet

Maintenant que vous avez installé Kubernetes avec succès sur tous vos nœuds, la section suivante vous guidera dans le déploiement d’applications à l’aide de ce puissant outil d’orchestration.

Comment déployer des applications sur Kubernetes

Tous les composants nécessaires étant désormais installés et configurés, déployons votre première application sur vos nœuds. Faites attention aux nœuds sur lesquels chaque étape est mise en œuvre.

1. Démarrer un cluster Kubernetes (nœud maître)

Commencez par créer un cluster Kubernetes, ce qui implique de configurer votre nœud maître comme plan de contrôle. Cela lui permet de gérer les nœuds de travail et d’orchestrer les déploiements de conteneurs dans tout le système.

- Démarrez votre cluster à l’aide de la commande kubeadm suivante :

sudo kubeadm init

- Si l’opération réussit, vous devriez voir s’afficher le résultat suivant :

[init] Using Kubernetes version: v1.30.0

[preflight] Running pre-flight checks

[preflight] Pulling images required for setting up a Kubernetes cluster

...

Your Kubernetes control-plane has initialized successfully!

- Notez l’adresse IP et le jeton de la ligne kubeadm join, car vous en aurez besoin pour ajouter vos nœuds de travail à ce cluster :

kubeadm join 22.222.222.84:6443 --token i6krb8.8rfdmq9haf6yrxwg \

--discovery-token-ca-cert-hash sha256:bb9160d7d05a51b82338fd3ff788fea86440c4f5f04da6c9571f1e5a7c1848e3

- Si vous rencontrez des problèmes lors du démarrage, vous pouvez contourner les erreurs de pré-vol à l’aide de cette commande :

sudo kubeadm init --ignore-preflight-errors=all

- Une fois le cluster démarré, créez un répertoire pour la configuration du cluster et définissez les autorisations appropriées :

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

- Utilisez la commande kubectl suivante pour vérifier l’état du cluster et des nœuds :

kubectl get nodes

- Voici le résultat attendu :

NAME STATUS ROLES AGE VERSION

master NotReady control-plane 176m v1.30.0

2. Ajouter des nœuds au cluster (nœuds de travail)

Passez au serveur que vous souhaitez ajouter en tant que nœud de travail. Assurez-vous d’avoir suivi toutes les étapes préparatoires de la section Comment configurer Kubernetes afin de confirmer que le nœud est prêt à être intégré au cluster.

Suivez ces étapes :

- Utilisez la commande kubeadm join avec l’adresse IP et le jeton précédemment notés :

kubeadm join 22.222.222.84:6443 --token i6krb8.8rfdmq9haf6yrxwg \

--discovery-token-ca-cert-hash sha256:bb9160d7d05a51b82338fd3ff788fea86440c4f5f04da6c9571f1e5a7c1848e3

- Répétez ce processus pour chaque serveur que vous souhaitez ajouter en tant que nœud de travail au cluster.

- Une fois tous les nœuds ajoutés, retournez à votre nœud maître pour vérifier l’état de tous les nœuds. Utilisez la commande kubectl :

kubectl get nodes

- Vous devriez obtenir le résultat suivant :

NAME STATUS ROLES AGE VERSION

master Ready control-plane 176m v1.30.0

worker-node1 Ready worker 5m v1.30.0

3. Installer un réseau de pods Kubernetes (nœud maître)

Un réseau de pods permet à différents nœuds d’un cluster de communiquer entre eux. Plusieurs extensions de réseau de pods sont disponibles, telles que Flannel et Calico. Suivez ces étapes pour en installer une :

- Si vous choisissez Flannel comme réseau de pods, exécutez la commande suivante :

kubectl apply -f https://github.com/flannel-io/flannel/releases/latest/download/kube-flannel.yml

- Si vous préférez Calico, utilisez plutôt cette commande :

kubectl apply -f https://raw.githubusercontent.com/projectcalico/calico/v3.25.0/manifests/calico.yaml

- Après avoir installé le réseau de pods, assurez-vous qu’aucun taint inutile n’empêche la planification sur les nœuds du plan de contrôle :

kubectl taint nodes --all node-role.kubernetes.io/control-plane-:NoSchedule-

4. Vérifier et déployer l’application (nœud maître)

Il est maintenant temps de déployer votre application, qui est packagée sous forme d’image Docker à l’aide de Kubernetes. Suivez ces étapes :

- Vérifiez si votre cluster et tous les pods du système sont opérationnels :

kubectl get pods -n kube-system

- Vous devriez obtenir un résultat similaire à celui-ci :

NAME READY STATUS RESTARTS AGE

coredns-7db6d8ff4d-4cwxd 0/1 ContainerCreating 0 3h32m

coredns-7db6d8ff4d-77l6f 0/1 ContainerCreating 0 3h32m

etcd-master 1/1 Running 0 3h32m

kube-apiserver-master 1/1 Running 0 3h32m

kube-controller-manager-master 1/1 Running 0 3h32m

kube-proxy-lfhsh 1/1 Running 0 3h32m

kube-scheduler-master 1/1 Running 0 3h32m

- Déployez votre application en intégrant votre image Docker dans le cluster. Remplacez your_kubernetes_app par le nom de votre déploiement et your_docker_image par l’image Docker réelle :

kubectl run your_kubernetes_app --image=your_docker_image

- Pour vérifier que votre application a bien été déployée, exécutez la commande suivante :

kubectl get pods

- Vous devriez voir s’afficher :

NAME READY STATUS RESTARTS AGE

your_kubernetes_app 1/1 Running 0 6m

Félicitations, vous avez déployé votre application sur le cluster à l’aide de Kubernetes. Vous avez désormais franchi une étape supplémentaire vers la mise à l’échelle et la gestion de votre projet dans plusieurs environnements.

Meilleures pratiques Kubernetes

Il est essentiel de respecter les meilleures pratiques développées au sein de la communauté Kubernetes pour tirer pleinement parti de ses capacités.

Optimiser la gestion des ressources

Une gestion efficace des ressources est essentielle pour améliorer les performances et la stabilité de vos applications. En définissant des limites et des demandes de ressources pour différents objets, tels que les pods, vous établissez un environnement stable pour gérer efficacement les applications conteneurisées.

Les limites de ressources plafonnent l’utilisation du processeur et de la mémoire afin d’empêcher une seule application de monopoliser les ressources, tandis que les demandes de ressources garantissent que vos conteneurs disposent des ressources minimales dont ils ont besoin.

Il est essentiel de trouver le bon équilibre entre ces limites et ces demandes pour obtenir des performances optimales sans gaspiller de ressources.

Assurer les contrôles de santé et l’auto-réparation

L’un des principes fondamentaux de Kubernetes consiste à maintenir l’état souhaité des applications grâce à des contrôles de santé automatisés et des mécanismes d’auto-réparation.

Les sondes de disponibilité gèrent le trafic entrant, garantissant qu’un conteneur est entièrement prêt à traiter les demandes. Elles empêchent également le trafic d’atteindre les conteneurs qui ne sont pas prêts, améliorant ainsi l’expérience utilisateur et l’efficacité du système.

Parallèlement, les sondes de vivacité surveillent l’état de santé continu d’un conteneur. Si une sonde de vivacité échoue, Kubernetes remplace automatiquement le conteneur problématique, maintenant ainsi l’état souhaité de l’application sans intervention manuelle.

Configurations sécurisées et secrets

ConfigMaps stocke les données de configuration, tandis que Secrets contient de manière sécurisée les informations sensibles telles que les clés API et les mots de passe, garantissant que ces données sont cryptées et accessibles uniquement aux utilisateurs autorisés.

Nous vous recommandons également d’appliquer les meilleures pratiques suivantes en matière de sécurité :

- Limitez l’accès à l’API. Limitez l’accès à l’API aux adresses IP de confiance afin de renforcer la sécurité.

- Activez le RBAC. Utilisez le contrôle d’accès basé sur les rôles (RBAC) pour restreindre les autorisations au sein de votre cluster en fonction des rôles des utilisateurs, afin de garantir que ceux-ci n’aient accès qu’aux ressources nécessaires à leurs rôles.

- Mises à jour régulières. Maintenez tous les composants de votre cluster Kubernetes à jour afin de vous protéger contre d’éventuelles failles de sécurité.

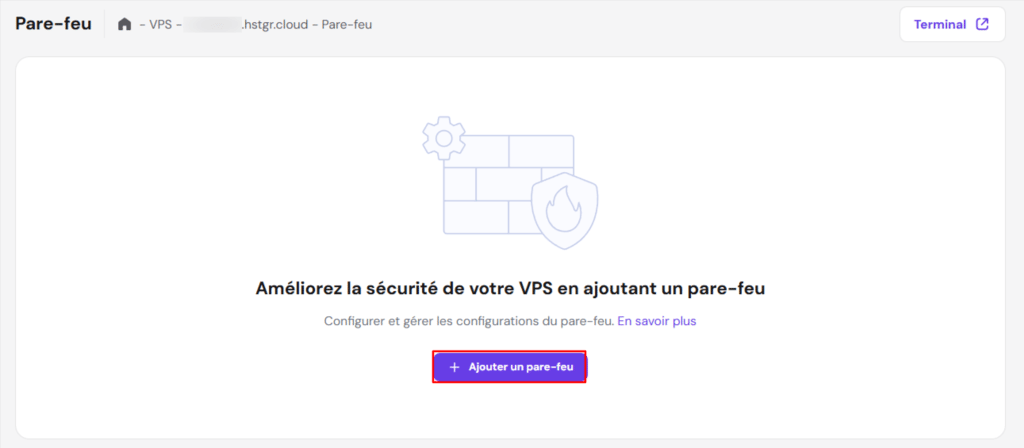

De plus, Hostinger offre des fonctionnalités de sécurité améliorées pour protéger votre VPS. Il s’agit notamment d’une solution de pare-feu basée sur le cloud qui aide à protéger votre serveur virtuel contre les menaces Internet potentielles.

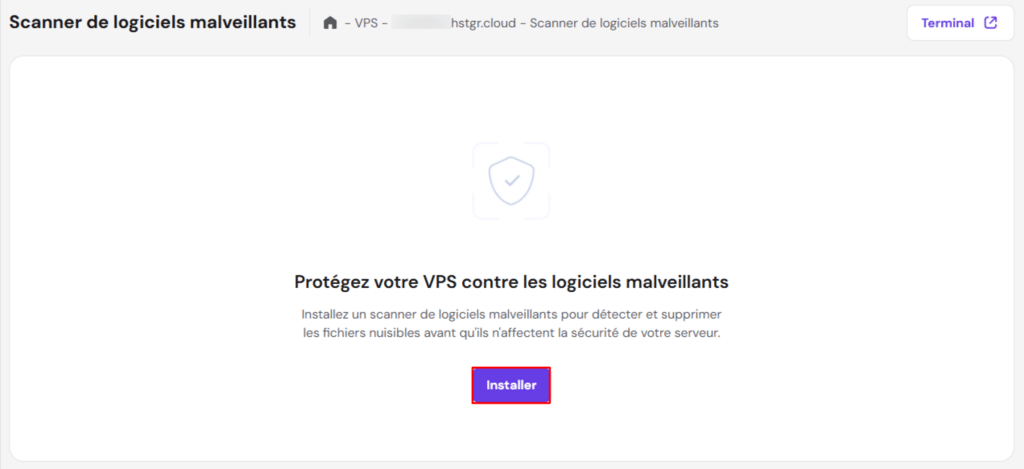

De plus, notre scanner de logiciels malveillants robuste assure une surveillance et une sécurité proactives de votre VPS en détectant, gérant et nettoyant les fichiers compromis et malveillants.

Vous pouvez activer ces deux fonctionnalités via le menu Sécurité du tableau de bord VPS de hPanel.

Exécuter des mises à jour et des restaurations continues

Kubernetes excelle grâce à sa stratégie de mise à jour continue, qui permet de supprimer progressivement les anciens conteneurs et de les remplacer par de nouvelles versions.

Cette approche garantit des transitions transparentes et des déploiements sans interruption, maintenant un service ininterrompu et offrant une expérience utilisateur supérieure, même lors de mises à jour importantes des applications.

Utiliser Minikube pour le développement et les tests locaux

Si vous préférez développer vos applications localement avant de les déployer sur le serveur, pensez à utiliser Minikube. Il s’agit d’un outil permettant de configurer des clusters Kubernetes à nœud unique sur des machines locales, idéal pour la création, les tests et l’apprentissage.

Suivez ces étapes pour démarrer Minikube sur une machine basée sur Debian :

- Téléchargez le dernier binaire Minikube :

curl -LO https://storage.googleapis.com/minikube/releases/latest/minikube_latest_amd64.deb

- Installez Minikube à l’aide du paquet Debian :

sudo dpkg -i minikube_latest_amd64.deb

- Démarrez Minikube sur votre machine :

minikube start

- Créez un exemple de déploiement avec kubectl :

kubectl create deployment hello-minikube --image=kicbase/echo-server:1.0

- Exposez le déploiement sur le port 8080, ce qui crée effectivement un service :

kubectl expose deployment hello-minikube --type=NodePort --port=8080

- Lancez votre service :

kubectl get services hello-minikube

minikube service hello-minikube

Vous pouvez désormais accéder à votre application en saisissant http://localhost:8080/ dans le navigateur.

Dépannage des problèmes courants liés à Kubernetes

Nous allons aborder ici certains problèmes courants liés à Kubernetes et expliquer comment les résoudre efficacement :

Pannes de pod

Les défaillances de pod surviennent lorsque ces composants ne fonctionnent pas comme prévu, perturbant la disponibilité et les performances de vos applications. Les causes courantes des défaillances de pod sont les suivantes :

- Contraintes de ressources. Les pods peuvent échouer en raison d’une insuffisance de CPU, de mémoire ou d’autres ressources sur le nœud, ce qui entraîne l’épuisement des ressources.

- Mauvaises configurations. Des erreurs telles que la spécification d’un nom d’image incorrect ou le montage de volumes erronés peuvent provoquer des défaillances.

- Problèmes d’image. Des problèmes tels que des dépendances manquantes ou des échecs de récupération d’image peuvent empêcher les pods de fonctionner correctement.

Voici les étapes à suivre pour dépanner les défaillances de pods :

- Utilisez la commande kubectl describe pod [nom_du_pod] pour obtenir des informations détaillées sur l’état du pod, notamment les événements, les journaux et les spécificités de configuration. Recherchez les messages d’erreur qui pourraient indiquer la cause de la défaillance.

- Vérifiez les demandes et les limites de ressources du pod dans sa configuration pour vous assurer qu’elles correspondent à ce qui est disponible sur le nœud.

- Exécutez kubectl logs [nom_du_pod] pour consulter les journaux des conteneurs du pod, qui contiennent souvent des indices sur les erreurs ou les problèmes opérationnels.

- Assurez-vous que les références d’image, les variables d’environnement, les montages de volume et les autres paramètres du pod sont corrects.

- Résolvez tous les problèmes liés au réseau, tels que la configuration DNS ou les problèmes de connectivité qui pourraient affecter le pod.

- Si le nœud lui-même rencontre des problèmes, résolvez-les ou autorisez Kubernetes à replanifier le pod sur un nœud sain.

Problèmes de réseau

Les problèmes de réseau dans un cluster Kubernetes peuvent perturber la communication entre les pods et les services, ce qui a un impact sur les fonctionnalités de vos applications. Voici quelques problèmes courants liés au réseau :

- Connectivité des services. Les défaillances dans la communication des services peuvent provenir de définitions de services mal configurées, de politiques réseau inappropriées ou de problèmes réseau sous-jacents.

- Résolution DNS. Les problèmes liés au DNS peuvent perturber la découverte des services et la communication entre les pods, car ceux-ci dépendent souvent du DNS pour s’identifier les uns les autres.

- Partitionnement du réseau. Dans les systèmes distribués, ces perturbations peuvent isoler des nœuds, entraînant une incohérence des données et des interruptions de service.

Voici comment résoudre les problèmes de réseau :

- Assurez-vous que les noms et les ports des services sont correctement configurés. Utilisez kubectl get services pour inspecter les détails des services.

- Vérifiez que vos politiques réseau sont correctement définies pour contrôler le flux de trafic entre les pods. Les politiques doivent être configurées pour autoriser ou refuser le trafic selon les besoins.

- Vérifiez que les paramètres DNS dans Kubernetes et au niveau du cluster sont corrects. Utilisez des outils tels que nslookup ou dig pour tester la résolution DNS au sein de votre cluster.

- Si vous utilisez des extensions de réseau telles que Calico ou Flannel, vérifiez leurs configurations et leurs journaux pour détecter d’éventuels problèmes.

- Utilisez kube-proxy pour gérer efficacement les communications réseau entre les services et les pods.

- Renforcez la sécurité en mettant en œuvre des politiques réseau qui restreignent le trafic. Elles protègent votre cluster contre les accès non autorisés et les connexions réseau indésirables.

Défis liés au stockage persistant

Dans Kubernetes, la gestion du stockage persistant est cruciale pour l’exécution d’applications avec état. Cependant, une gestion inadéquate peut entraîner des pertes de données, des interruptions d’application et une dégradation des performances. Voici quelques problèmes courants dans ce domaine :

- Allocation des ressources. Sous-estimer les besoins en stockage peut entraîner une perte de données, tandis qu’un surprovisionnement peut entraîner des dépenses inutiles.

- Inadéquation entre le volume persistant (PV) et la classe de stockage. Les erreurs de configuration entre les PV et les classes de stockage peuvent entraîner des problèmes de compatibilité, compliquant l’attachement du stockage approprié à vos pods.

- Perte de données. Cela peut se produire pour diverses raisons, notamment des plantages de pods, des suppressions ou des pannes matérielles.

Voici le guide pour résoudre les problèmes liés au stockage persistant :

- Vérifiez régulièrement les besoins de stockage de votre application et ajustez les demandes et les limites de ressources en conséquence. Utilisez des indicateurs et des outils de surveillance pour identifier les ressources sous-provisionnées ou surprovisionnées.

- Vérifiez que vos PV et vos classes de stockage sont correctement appariés. Vérifiez la configuration de votre classe de stockage pour vous assurer qu’elle répond aux caractéristiques souhaitées, telles que les performances et les modes d’accès.

- Explorez les options de récupération des données, telles que les snapshots, pour récupérer les données perdues ou corrompues. Envisagez des solutions de sauvegarde qui s’intègrent bien à votre fournisseur de stockage afin de faciliter la restauration des données.

- Automatisez le processus de sauvegarde pour garantir une protection cohérente et régulière des données. Mettez en œuvre des solutions de sauvegarde automatisées ou des scripts qui s’exécutent à intervalles réguliers.

- Optez pour des solutions de stockage pouvant évoluer rapidement afin de répondre à des demandes croissantes. Mettez en œuvre des systèmes de stockage pouvant s’étendre de manière dynamique à mesure que vos applications conteneurisées nécessitent davantage de stockage.

Évolutivité et performances des clusters

L’évolutivité est une caractéristique essentielle de Kubernetes, qui permet aux applications de s’adapter à des charges de travail variables. Cependant, à mesure que vos applications se développent, vous pouvez rencontrer des problèmes d’évolutivité et des goulots d’étranglement en termes de performances, tels que :

- Conflit de ressources. La concurrence entre les pods pour des ressources telles que le CPU et la mémoire peut entraîner des problèmes de performances, les pods limités ne fonctionnant pas de manière optimale.

- Encombrement du réseau. L’augmentation du trafic peut saturer la bande passante du réseau, entraînant des retards de communication et une dégradation des performances.

- Gestion inefficace des ressources. Un paramétrage inapproprié des demandes et des limites de ressources peut entraîner du gaspillage.

Voici les principales stratégies pour optimiser les performances et la mise à l’échelle :

- Évaluez régulièrement les demandes et les limites de ressources pour vos pods et ajustez ces valeurs en fonction des besoins des applications et de la disponibilité des ressources.

- Utilisez HorizontalPodAutoscaler (HPA) pour faire évoluer dynamiquement les pods en fonction de l’utilisation des ressources ou de métriques personnalisées. Cela permet à vos applications de gérer automatiquement les pics de trafic sans intervention manuelle.

- Surveillez le trafic réseau et appliquez des politiques réseau pour gérer efficacement le flux de trafic. Envisagez d’utiliser des interfaces réseau de conteneurs (CNI) avancées et des extensions pour améliorer les performances réseau.

- Utilisez kube-controller-manager pour automatiser la mise à l’échelle des nœuds en fonction des demandes de ressources, ce qui rend le système plus réactif aux changements de charge de travail.

- Vérifiez et affinez le code de vos applications conteneurisées afin de garantir une utilisation efficace des ressources. Suivez les meilleures pratiques en matière d’orchestration des conteneurs afin d’améliorer les performances.

- Supprimez régulièrement les images Docker, les conteneurs, les services et les volumes inutilisés afin de libérer des ressources. Utilisez des commandes telles que docker system prune pour Docker et kubectl delete pour les ressources Kubernetes afin de maintenir un environnement propre.

Conclusion

Kubernetes est un outil puissant qui simplifie la gestion et le déploiement des applications, garantissant leur bon fonctionnement sur les serveurs dans les environnements locaux et cloud.

Dans ce tutoriel Kubernetes pour débutants, vous avez découvert ses composants principaux et ses fonctionnalités clés, configuré un environnement en cluster et déployé votre première application à l’aide de cette plateforme.

En respectant les meilleures pratiques et en relevant les défis de manière proactive, vous pouvez tirer pleinement parti des capacités de ce système open source pour répondre à vos besoins en matière de gestion de conteneurs.

Tuto Kubernetes – FAQ

À quoi sert Kubernetes ?

Kubernetes est principalement utilisé pour l’orchestration de conteneurs. Il automatise le déploiement, la mise à l’échelle et la gestion des applications conteneurisées, garantissant une utilisation efficace des ressources, une évolutivité améliorée et une gestion simplifiée du cycle de vie dans les environnements cloud natifs.

Kubernetes est-il identique à Docker ?

Non, ils ont des objectifs différents. Docker est une plateforme de conteneurisation qui regroupe les applications dans des conteneurs. Kubernetes, quant à lui, est un système qui gère ces conteneurs au sein d’un cluster, prenant en charge Docker et d’autres environnements d’exécution de conteneurs.

Comment commencer à apprendre Kubernetes ?

Commencez par comprendre les bases grâce au tutoriel et à la documentation officiels de Kubernetes. Ensuite, configurez un cluster Kubernetes, soit localement, soit auprès d’un fournisseur de cloud. Mettez en pratique ce que vous avez appris en déployant et en gérant des applications. Rejoignez des forums et des communautés en ligne pour obtenir de l’aide et des conseils supplémentaires.

Kubernetes convient-il aux petits projets ? Est-il principalement destiné aux applications à grande échelle ?

Bien que Kubernetes offre des fonctionnalités robustes idéales pour gérer des applications complexes à grande échelle, il peut être excessif pour les projets plus petits en raison de sa complexité de configuration et de maintenance continue. Les projets plus petits peuvent envisager des alternatives plus simples, à moins qu’ils ne nécessitent les capacités spécifiques de Kubernetes.

Tout le contenu des tutoriels de ce site est soumis aux normes éditoriales et aux valeurs rigoureuses de Hostinger.